英伟达Tesla V100是英伟达公司于2017年发布的一款基于Volta架构的高性能数据中心GPU,它代表了当时GPU加速计算和人工智能训练领域的巅峰之作,其集成电路研发体现了多项突破性技术创新。

核心架构:Volta与Tensor Core的革命

Tesla V100的核心是英伟达首款采用Volta架构的GPU。其集成电路设计最革命性的部分是引入了Tensor Core。与传统CUDA核心专注于单精度浮点运算不同,Tensor Core是专为深度学习矩阵运算设计的专用核心,能够在一个时钟周期内执行4x4矩阵的融合乘加运算,为深度学习训练和推理提供了前所未有的吞吐量。这使得V100在进行混合精度训练时,其浮点运算性能(FP16)最高可达125 TFLOPS。

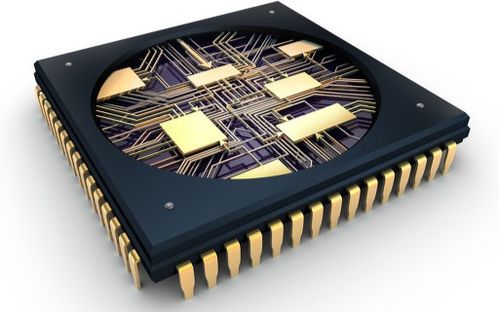

制程工艺与规模:巨大的硅片雄心

V100采用了当时最先进的12纳米FFN制程工艺(由台积电制造)。其芯片尺寸达到了惊人的815平方毫米,集成了211亿个晶体管。如此庞大的芯片规模和晶体管数量,旨在提供极致的并行计算能力。芯片内部集成了80个流式多处理器,共计5120个CUDA核心和640个Tensor Core,展现了英伟达在超大规模集成电路设计、功耗控制和散热解决方案上的深厚功力。

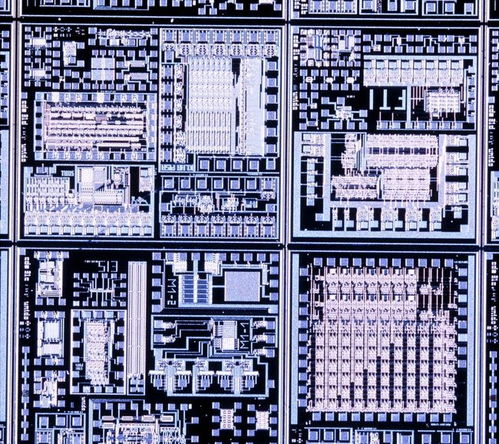

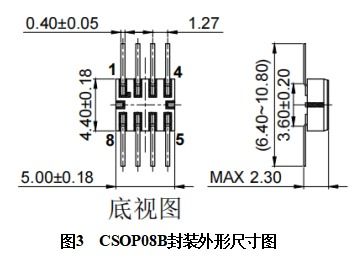

内存子系统:高带宽与大容量

为了喂饱如此强大的计算核心,V100配备了高性能的HBM2(高带宽内存2)显存。其集成电路设计通过先进的2.5D堆叠封装技术(使用硅中介层),将GPU核心与四个HBM2内存堆栈紧密集成在一起,提供了高达900GB/s的显存带宽,远超上一代产品的带宽。初期版本提供16GB显存,后续推出的V100 32GB版本更是将容量翻倍,满足了大规模模型和数据集的苛刻需求。

互联技术:NVLink的威力

V100的另一个关键集成电路特性是集成了第二代NVLink高速互联技术。每个V100 GPU提供了高达300GB/s的片间双向带宽,是传统PCIe带宽的10倍以上。这使得多GPU系统能够以前所未有的效率共享数据和协同工作,为构建大规模AI训练集群和高效能计算系统奠定了硬件基础。

应用影响与研发意义

Tesla V100的研发成功,不仅是集成电路设计的一次壮举,更彻底改变了人工智能和高性能计算的基础设施格局。它使得训练像GPT这样的超大模型从不可能变为可能,极大地加速了AI研究的进程。从集成电路研发角度看,V100的成功验证了专用计算单元(Tensor Core)、先进封装(2.5D with HBM)、超高速互联(NVLink)与通用大规模并行架构相结合的技术路线,为后续的Ampere、Hopper等架构指明了方向。

英伟达Tesla V100是一款里程碑式的产品,它通过一系列顶级的集成电路设计与研发创新,将GPU从图形处理器重新定义为“通用并行计算加速器”,开启了AI计算的新纪元,其设计理念至今仍深刻影响着整个行业。